最近看到一個東西,DeepSeek。中國來的 AI。有點意思。

大家都在講 GPT-4、Gemini... 都是些大公司的遊戲。突然跑出一個挑戰者,而且玩法不太一樣。就想說來整理一下筆記。

重點一句話

簡單講,他們用一連串聰明的方法,把一個超級大的 AI 模型,一步步「煉」成比較小、但一樣聰明、而且便宜很多的版本,最後還把程式碼都公開了。

這東西是怎麼煉成的?

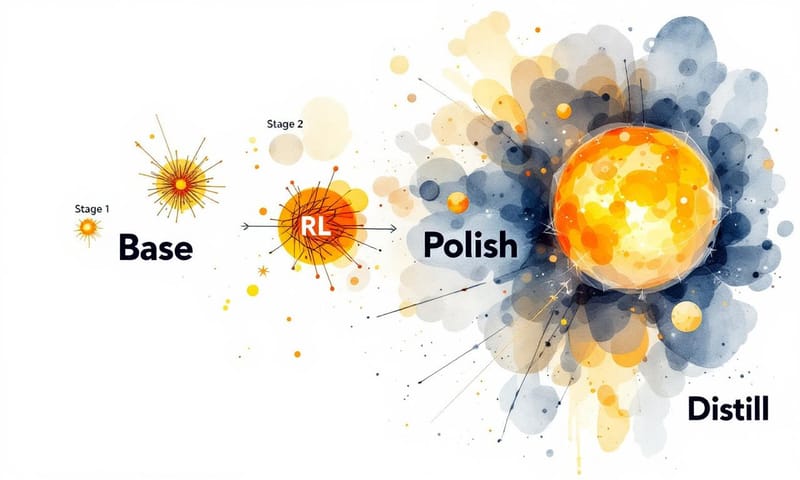

我看了一下他們的資料,整個過程蠻有趣的,不像一般公司就直接丟一個模型出來。它有好幾個階段,像在養小孩。

它的基礎是一個叫 DeepSeek-V3 Base 的東西。一個...嗯...一個超級無敵大的基礎模型,有 670 億個參數。但厲害的地方是,它用了所謂的「混合專家模型 (MoE)」。

這個 MoE 的概念,你可以想像成... 公司裡養了一大堆不同領域的專家,但每次開會,你只會叫跟議題相關的那幾個專家進來。這樣超有效率,不用每次都全員到齊。所以模型雖然很大,但跑起來不會慢到死。

再來,從這個巨大基礎上,他們養出了 R1-Zero。

這個階段很關鍵。他們完全不用人類的資料去教它,就是純粹的「強化學習 (RL)」。給它一個目標,一個獎勵機制,然後放手讓它自己去碰撞、去學習怎麼「思考」。像是在一個封閉的房間裡練功,練出內力。

練完內功,就是 R1 模型了。這時候才開始加入人類的資料(SFT),像是給它看大量的書、文章,教它怎麼跟人一樣好好說話、好好推理。等於是把前面練出的內力,變成實際能用的招式。這個版本,性能就已經能跟 GPT-4 那些頂尖模型叫板了。

但他們沒停在這裡。最後一步,我覺得是最重要的,叫 DeepSeek-R1-Distill。

Distill 就是「蒸餾」。他們把前面那個又大又強的 R1 模型當作老師,然後教出一個個更小的學生模型。這個過程叫「知識蒸餾」。厲害的是,這些小模型幾乎繼承了老師大部分的推理能力,但體積小很多、跑起來快很多。

這一步,才是讓這個技術能真正被大家用的關鍵。因為不是每個人都有能力去養一個跟 GPT-4 一樣大的巨獸。

所以... 它跟 GPT-4 比起來,到底差在哪?

嗯...直接比較可能有點不公平,定位不太一樣。我整理個簡單的表,是我自己的看法。

| 比較項目 | DeepSeek 系列模型 | OpenAI's GPT-4 (參考用) |

|---|---|---|

| 開放性 | 幾乎都開源了。你可以下載整個模型,自己調整、研究。自由度超高。 | 完全的黑盒子。你只能透過它的 API 去呼叫它,付錢就是了。根本不知道裡面長怎樣。 |

| 成本 | 聽說 API 價格是 GPT-4o 的百分之一... 便宜到有點誇張。如果是自己部署開源版,那就主要是硬體成本。 | 就是...貴。不管是 API 費用還是 ChatGPT Plus 訂閱,都是一筆持續的開銷。 |

| 訓練哲學 | 感覺更像個「煉金術士」。從一個巨大的基礎,透過強化學習和蒸餾,煉出精華。很注重效率。 | 比較像「大力出奇蹟」。用海量的資料和算力,硬是堆出一個超強的模型。路徑很直接,也很花錢。 |

| 適合誰 | 開發者、研究員、想把 AI 整合進自己產品但預算有限的公司。需要一點點動手能力。 | 一般使用者、想快速驗證想法的開發者、不缺錢的大企業。求個方便省事。 |

所以你看,它不是要直接取代 GPT-4 給一般人用,它的目標客戶,更像是那些想「擁有」AI 能力的開發者和公司。

所以,這東西真的有人在用嗎?

這才是有趣的地方。我看到有醫生在 LinkedIn 上分享他的測試心得。

一位叫 Yudara Kularathne 的醫生,他自己試用後,整個嚇到。他說 DeepSeek AI 在醫療推理上的表現,比 99% 的住院醫師還強,甚至比 OpenAI 內部一個叫 o1 的模型還厲害。他說它不只給答案,還能把思考過程講得清清楚楚。

這點很重要。在醫療這種高風險領域,AI 不能只是個黑盒子。能解釋「為什麼」我會這樣判斷,比只給一個「你得了什麼病」的答案重要太多了。

這讓我想起,像是 GE Healthcare 一直在用 AI 輔助判讀醫療影像,就是為了找出人眼可能忽略的細節。現在有 DeepSeek 這種選項,或許未來更多小醫院或研究機構,也能用得起類似的技術了。

說到這個,我就想到台灣的狀況。

你看,美國有 OpenAI、Google,中國有 DeepSeek 這種。他們的路徑,都是先做出一個超強的基礎模型。台灣其實也在走這條路,像是國科會主導的 TAIWAN-LLM 計畫。但對我們更多數的中小企業、獨立開發者來說,要從頭訓練一個大模型根本不現實。

所以像 DeepSeek 這樣,提供一個便宜、開源、而且能力已經被驗證過夠強的「半成品」,反而更有價值。你可以把它下載下來,用自己的資料去做微調,變成一個專屬於你公司業務的 AI。這對資源沒那麼多的台灣廠商來說,是個很好的機會。你可以在 Hugging Face 這樣的開源社群平台上找到它,上面有很多開發者在交流。

嗯...我的想法是...

DeepSeek 不像是一個要跟 ChatGPT 在消費市場一決生死的產品。

它更像...一把強大的開源武器。它證明了,不一定要是世界首富或科技巨頭,也能訓練出頂尖的 AI。透過聰明的架構和蒸餾技術,AI 的門檻可以被大幅降低。

對開發者來說,這代表了更多的可能性和更低的成本。對整個產業來說,這代表了...嗯...一種去中心化的趨勢吧。AI 的未來,不會只掌握在少數幾家公司手裡。

這才是整件事最酷的地方。

最後想問問你,如果今天要做一個專案,你會選比較貴但方便的封閉模型(像 GPT-4 API),還是選便宜、自由度高但可能要自己多花點心力的開源模型(像 DeepSeek)?在下面留言聊聊你的考量吧。