嗯...今天要來聊一個,我自己覺得蠻有趣的東西。就是...你在網路上看到一張照片,可能是風景,也可能是某個街角,然後心裡就一直想...這到底是在哪裡拍的?

以前啊,要找出這答案,真的就是大海撈針。但現在有 AI 了嘛,很多人就想說,是不是把圖丟給 AI 就搞定了?嗯...對,也對,也不對。這中間有點...眉角。

重點一句話

老實說,AI 真的很會幫你開個頭,給你一個方向,但...要走到終點,找到那個最精準的位置,最後一哩路通常還是要靠你自己走。這就是所謂的「混合模式」。

為什麼圖片定位這件事,現在變得很重要啊?

這幾年社群媒體...你知道的,假消息、假新聞滿天飛。一張照片可能被亂配文字,就變成一個完全不一樣的故事。所以,能夠查證一張照片的原始拍攝地點,就變成一種...嗯,算是對抗假資訊的基本功吧。

不只是打假,很多公開來源情報(OSINT)的調查,也是靠這個來追查線索。從揭穿騙局到協助犯罪調查,都有它的影子。但說真的,這東西...急不得。它需要耐心,像在玩一個超大的拼圖遊戲。

以前我們這些...算是業餘愛好者吧,就是土法煉鋼。開一堆視窗,Google Maps、衛星圖、然後用關鍵字慢慢搜。你知道嗎,當年馬航 MH370 失蹤的時候,有個叫 Digital Globe 的公司,他們就調了兩顆衛星去拍疑似失事的區域,然後把幾十萬張照片放到一個叫 TOMNOD 的平台上,讓全世界的網友一起幫忙看。這算是...很早期的人機協作吧,用人海戰術去過濾機器拍回來的東西。

後來當然也出了一些好用的工具,像是 Bellingcat 他們那個 Open Street Map 工具,你輸入一些地景特徵,它就能幫你縮小範圍,到現在還是很準。Bellingcat 算是這個領域的權威了,他們很多調查報告都超精彩。

怎麼做:我自己的混合模式工作流

好,那現在有了 GPT-4o、Gemini 這些強大的 AI,整個流程可以更順。但就像我說的,不能完全依賴它。我自己摸索出一個...嗯,算是固定的流程吧,分享給你們參考。

第一步:先讓 AI 當你的免費顧問

拿到一張照片,先別急著自己找。直接把它丟給 AI,像是 ChatGPT 或 Google 的 Gemini。然後用一個很直接的 Prompt,不用太花俏。大概像這樣:

請分析這張圖片的地理位置線索。

幫我找出裡面的地標、街景、建築風格、車牌、植物或任何環境特徵。

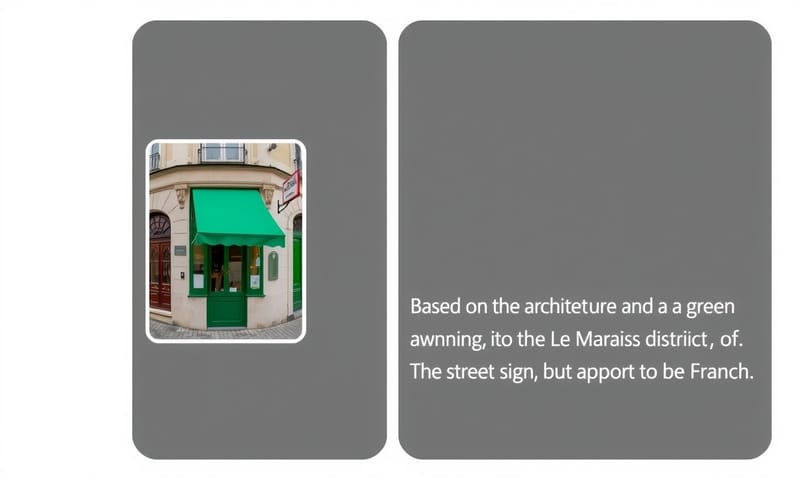

根據這些線索,推測幾個可能的地點,並說明你的理由。這一步的重點不是要 AI 給你正確答案,而是要它幫你「看」東西。它可能會看到一些你第一眼忽略的細節。

第二步:從 AI 的胡說八道裡提煉關鍵字

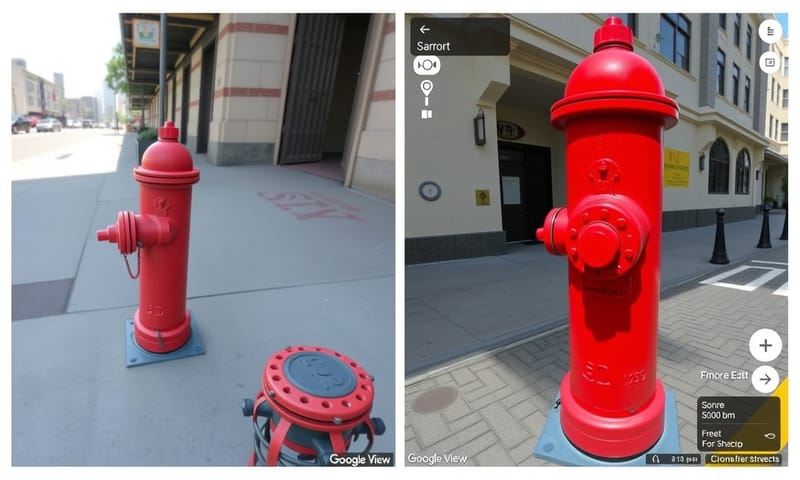

AI 很常...一本正經地胡說八道。它可能會說「根據這個櫻花樹,這可能在日本」,但那明明是台灣也很常見的山櫻花。所以,你要做的是把它回覆裡的「名詞」都抓出來,當成候選關鍵字。例如:「哥德式建築」、「紅色消防栓」、「綠色屋頂」、「Cobblestone(鵝卵石街道)」、「路牌上的 cyrillic 字母」之類的。

第三步:帶著關鍵字,回到 Google Maps 手動驗證

現在你有了一堆線索,就可以開始真正的偵探工作了。打開 Google Maps 和它的街景服務,開始組合這些關鍵字搜尋。

這一步就是經驗所在了。比如說,AI 說照片裡的建築風格像歐洲,但你看到旁邊的冷氣機室外機樣式...嗯,這很亞洲。這就是 AI 看不出來的「在地知識」。又或者,AI 辨識出是繁體中文,但它分不出來台灣跟香港的招牌用字、排版風格有什麼細微差別。但我們一看就知道,對吧?這就是我們比 AI 強的地方。

第四步:用專業工具做最後確認

當你把範圍縮小到一個城市甚至一條街之後,就可以用更專業的工具來比對。像是前面提到的 Bellingcat 工具,或是有些網站可以查全世界的電線桿、人孔蓋樣式...對,就是這麼細。當你能在街景上找到跟照片裡一模一樣的塗鴉、裂縫或店家招牌時,那種成就感,真的很棒。

純手動 vs. 純 AI vs. 混合模式,哪個好?

為了讓大家更清楚,我弄了個簡單的比較表。這完全是我自己的感覺啦。

| 方法 | 優點 | 缺點 | 我自己是覺得... |

|---|---|---|---|

| 純手動分析 | 準確度最高,能注意到 AI 忽略的文化細節。 | 超花時間...真的。如果圖片線索很少,會找到懷疑人生。 | 適合那種...時間很多,而且把這當成解謎遊戲在享受的人。 |

| 純依賴 AI | 速度快到不行,幾秒鐘就有方向。有時候運氣好,直接命中。 | 非常不可靠。它會幻想出不存在的細節,然後把你帶到完全錯誤的地方。 | 只適合拿來...嗯,快速過濾大量圖片,找出「可能」有關的。千萬別全信。 |

| 混合模式 (AI + 手動) | 效率和準確度的最佳平衡點。AI 幫你省下前期的力氣。 | 還是需要花時間做人工驗證。你需要學會判斷 AI 何時在鬼扯。 | 目前來說,我自己認為這是最實用、最可靠的工作方式。讓 AI 當你的助理,你當總編輯。 |

AI 也會踢到鐵板:這些情況下它通常會失靈

AI 不是萬能的,有些情況下你餵給它圖片,它也只會跟你說「無法辨識」。

- 線索太少:一片天空、一塊草地、一面白牆...這種照片,神仙也難救。

- 畫質太差或光線太暗:人都看不清楚了,就別為難 AI 了。它需要清晰的邊緣和細節來做判斷。

- 場景太過通用:一個看起來很普通的辦公室、一間連鎖飯店的房間...這種在全世界都長得差不多的地方,AI 很難定位。

- AI 的「幻覺」:這點最麻煩。有時候 AI 會「看到」不存在的東西。它可能把牆上的一塊污漬,辨識成某個品牌的 Logo,然後把你導向錯誤的方向。所以交叉驗證才這麼重要。

想練功?可以去這些地方玩玩

說了這麼多,其實最好的學習方式就是...實際去玩。真的,玩幾次你就有感覺了。

在 X (以前的 Twitter) 上,你可以去搜 #osintchallenge 這個標籤。會有很多高手或社群出題目,就是貼一張照片,讓大家比賽誰先找到地點。雖然沒獎品,但可以跟全世界的偵探們切磋,蠻酷的。

如果你想玩更專業、更像真實案件的,可以去 TryHackMe 或 Hack The Box 這類資安學習平台,它們上面都有很多 OSINT 相關的挑戰,其中圖片定位就是一個大宗。蠻推薦的。

總之,有了 AI 這個新玩具,圖片定位這件事變得比以前親民多了。雖然它還不完美,但已經是個...嗯,非常強大的起點了。

換你說說看:

如果今天你看到一張很想知道在哪拍的照片,你會選擇先丟給 AI 看看,還是相信自己的眼睛,直接開始當柯南呢?在下面留言分享你的想法吧!